Virtualisiertes Load Balancing im Fokus Server-Virtualisierung mit virtualisierten Load Balancern optimiert

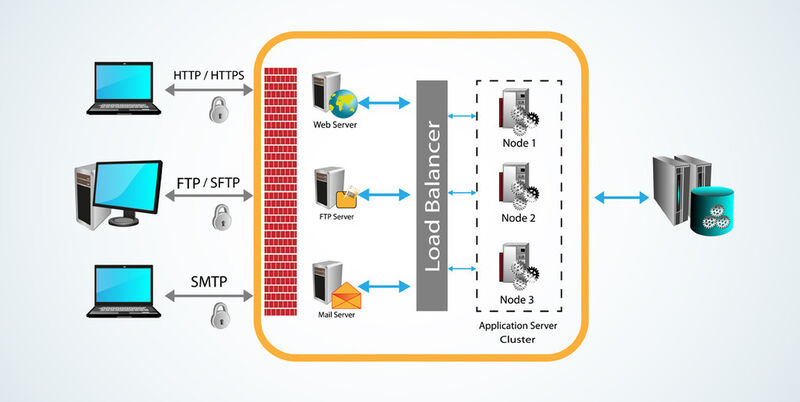

Der Trend zur Virtualisierung ist ungebrochen. Meist entsteht dabei eine gemischte Umgebung aus eigener und Cloud-basierter Infrastruktur plus Applikationen. Jetzt müssen die Zugriffe der Anwender auf die virtualisierten Server und Applikationen mithilfe von Load Balancern sinnvoll und flexibel verteilt werden.

Anbieter zum Thema

Virtualisierte Load Balancer reduzieren weiter die Anzahl physischer Ressourcen, die benötigt werden, um eine Anwendung zu effektiv bereitzustellen. Das wiederum senkt die Hardware- und Betriebskosten. Darüber hinaus sind sie auch flexibler als an Geräte-gebundene Load Balancer (Appliances). Die Leistung virtualisierter Load Balancer und ihre Integration in das Netzwerk können außerdem sehr schnell und mit wenig Aufwand an sich ändernde Anforderungen angepasst werden.

Im Zuge großflächiger Konsolidierungen sollten IT-Leiter also unbedingt auch die bisher verwendeten Konzepte für die anwendungsspezifische Ressourcen-Zuordnung überdenken.

Smarter arbeiten und Kosten senken

Die Konsolidierung betrifft aber auch die IT-Abteilungen selbst, die sich von Kostenstellen hin zu Service-Vermittlern für die Fachabteilungen wandeln. Mit einem geeigneten Berechnungsmodell kann diesen die eigene Nutzung der IT-Ressourcen genau aufgeschlüsselt in Rechnung gestellt werden. Die Ressourcen werden in diesem Modell nicht nur optimal bereitgestellt, sondern auch Hardware-, Software- und Netzwerk-Installationen auf das absolut Nötige reduziert. Statt zu viel Hard- und Software zu kaufen, um zukünftige Trends zu antizipieren, macht ein solches Berechnungsmodell die Nutzung transparent. Zudem hilft es Unternehmen, das Geschäftsmodell an einer optimierten Zuordnung der Ressourcen auszurichten.

Intelligente Load Balancer sind auch als Application Delivery Controller (ADC) bekannt. Sie bieten einen zuverlässigen Mechanismus, der Hochverfügbarkeit bei geschäftskritischen Anwendungen optimal sicherstellt, ohne dass andere Anwendungen auf überlasteten Servern „verhungern“ müssen.

Da in einer hochverfügbaren Anwendungs-Infrastruktur der gesamte Datenverkehr der Anwendung über die ADCs verarbeitet wird, sitzen sie an der richtigen Stelle, um ein Berechnungs-Framework zu unterstützen und Einblicke in die Infrastruktur-Auslastung zu liefern. Bei Verwendung einer mandantenfähigen Lösung können Unternehmen zudem die Steuerung der Applikationsbereitstellung voneinander unabhängig und individuell in die Hände der Fachbereiche verlagern.

Load Balancing und Application Delivery

Load Balancing-Lösungen sind seit fast zwei Jahrzehnten im Einsatz – sie verteilen Zugriffe auf Server-Anwendungen (Balancing), stellen sicher, dass User je nach Anwendung stets zum selben Server gelangen (Persistence), und prüfen ob die Anwendungen auf den Servern auch tatsächlich verfügbar sind (Healthcheck).

ADCs bieten zusätzliche Funktionalität, die den Wirkungsgrad der Anwendung erhöht. Dazu gehört einerseits das Überwachen des Betriebszustandes und der Anwendungslasten direkt auf dem Server, und davon abhängig das Treffen von Entscheidungen zur Lastverteilung. ADCs agieren auf Anwendungsebene (Layer 7) und können damit auf spezifische Anwendungsparameter reagieren. Andererseits analysieren sie die Endanwender-Anforderungen an die Software und leiten Anwendungsanfragen an den für diese Aufgabe am besten geeigneten Server weiter.

Sicherheit inklusive

Diese Analyse der Datenpakete ermöglicht darüber hinaus den Einsatz von Security-Mechanismen. Von der Erkennung und Behandlung von DoS-Attacken, über Intrusion Prevention-Mechanismen bis hin zur immer wichtiger werdenden Web Application Firewall (WAF) stellen ADCs die heute notwendigen Funktionen integriert zur Verfügung. Sie interagieren mit den Anwendern, fragen Login-Informationen ab und steigern mit Single-SignOn-Mechanismen den Nutzungskomfort von Anwendungen – und erhöhen durch die implizite Reverse-Proxy-Funktion gleichzeitig die Sicherheit auf Serverseite bei der Anwendungsbereitstellung außerhalb des Unternehmens-Netzwerks.

Ein bidirektionales Monitoring gibt Auskunft über die Performance und Nutzung der Applikationen. Über APIs fließen diese Daten in unterschiedliche Management- und Monitoring-Lösungen wie z.B. Microsoft System Center oder Nagios ein, um so für eine konsolidierte Ansicht auf die gesamte Anwendungslandschaft zu sorgen. So kann die IT-Abteilung die Anwendungsleistung und Ressourcennutzung verbessern, aber im Bedarfsfall auch neue Server hinzunehmen.

Mit der Konsolidierung der Rechenzentren sollte man auch über den sinnvollsten Ansatz bei der applikationszentrierten Ressourcennutzung nachdenken. Ein führender Finanzdienstleister beschreitet beispielsweise einen neuen Weg. Statt zuerst Infrastrukturen aufzubauen und dann die Anwendungen bereitzustellen, hat er das Verfahren umgedreht. Das Unternehmen, das fast seine gesamte Infrastruktur inklusive aller Anwendungen virtualisiert hat, schreibt erst die Anwendungen und entscheidet danach, welche Infrastrukturen zu deren Unterstützung benötigt werden.

Dem CIO zufolge verschafft dieser „flüssige“ Ansatz der Organisation eine größere Flexibilität während des gesamten Lebenszyklus der Applikation: vom Bereitstellen über das Verlagern bis hin zur Außerbetriebnahme.

Ein weiterer Vorteil ist das bessere Verknüpfen von Anwendungen und Ressourcen. Virtualisierte ADC lassen sich hier ideal integrieren, wenn die Lizensierung einen „pay-as-you-grow“-Ansatz unterstützt – es fallen nur die Kosten für die tatsächlich benötigte Leistung an, diese kann stufenweise und ohne Notwendigkeit der Aufrüstung von proprietärer Hardware erweitert werden.

Fazit

Beim Konsolidieren unternehmensweiter Rechenzentren kommt es darauf an, betriebliche Konsistenz zwischen Ressourcen sicherzustellen, die in die Cloud wandern, und solchen, die vor Ort verbleiben. Dank dieser Konsolidierung können Unternehmen ihre Betriebskosten (TCO) senken sowie flexibler und effizienter werden.

Doch noch viel drastischere Kosteneinsparungen stellen sich ein, wenn die Server-Virtualisierung mit virtualisierten Load Balancern kombiniert wird. Virtuelle ADCs erhöhen die Anwendungsleistung, Verfügbarkeit, Skalierbarkeit und geschäftliche Agilität – sowohl in traditionellen Rechenzentren als auch in dynamischen und flexibel anpassbaren Hybrid-Cloud-Umgebungen.

Über den Autor

Detlef Lilje ist Director Central/Eastern Europe and Middle East bei KEMP Technologies EMEA.

(ID:43004771)

:quality(80)/p7i.vogel.de/wcms/99/ab/99ab960dc06510df4b8a1408fb816382/0126822685v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c6/1f/c61fa9e09fbfcdbf0ea821ac6b630aef/0126873569v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/5d/02/5d02e24caafc3a16fc10fc839726c1d5/0127065525v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/41/9e/419e47a464d355383c41596b648c5e80/0131225183v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/a6/bd/a6bdec579c02d85292a290267ca21def/0130597315v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c4/ed/c4ed63b7d156a665de0cb3f80e743d35/0130971569v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/e5/90/e59060f59ffc127bf30c1dbbcad27bde/0131092429v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/60/ba/60bad225c2882846cd2196c544d0eca1/0130962097v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b7/69/b7696e318a6885a874e524c1c6bfc5b4/0130412587v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/2f/04/2f048f15110fc247181aa394f7a7833b/0130052204v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f4/1a/f41aaf9f2d61b037e6bb6d8d096c3404/0130971688v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bc/b6/bcb63b1a39cc4746397f56905faf7f94/0130850698v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/cd/ea/cdea095061f91cbd70baf44bf32c1384/0130912250v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/68/c2/68c2546cc446e05e8ad0fccf0700a2d9/0130816577v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/dd/9b/dd9b3ac78808e64337a2c5c3348c5075/0131017459v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/3d/46/3d4616644d86ec1251065ec442f430c7/0131116394v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/25/fb/25fb5b5871bfa1ffaf8cd047122a9b8d/0130860848v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/34/bd/34bd2a1b51f8ccfee3a78eeb617cc514/0130883643v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/14/ec/14ec72565acc671ae679eab6f329bfea/0130539648v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/c7/e3/c7e3002b2a462c5dbcb96441e7830f4d/0130814757v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/cc/ce/ccce0e1da8ad2b01c06e2f066ba1d9c5/0129576026v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/f5/b7/f5b7dbb597c54b76ca349df94e64f29a/0130885606v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/54/9a/549ad2a117aed10ded1fa1b7d651f00c/0130681867v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/d2/44/d24407cea22d64a914ef0dd4d68c0824/0131063292v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/88/0b/880b08ff5a17d48199380c9a852993f0/0131023976v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/28/dd/28dd9a9594c42a94b13ed9c6e523f0be/0130814594v2.jpeg)

:quality(80)/p7i.vogel.de/wcms/39/1a/391ac3549f6a3164ea00decb9bb9a27b/0131289523v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/b4/a2/b4a2e2b6c49c8a9a53f9374169a97fd4/0131047762v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bd/00/bd0005c8c528ec054bd1181decbf8187/0129070776v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/bb/dd/bbdd4200c21c0a24391b4511119bc030/0128991187v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/9b/a8/9ba84bf777968072ccdbcc132daa2fcb/0127162321v1.jpeg)

:fill(fff,0)/p7i.vogel.de/companies/68/6f/686fc7578ffbe/globallogo-nttdata-futureblue-rgb.jpeg)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/93500/93524/65.jpg)

:fill(fff,0)/images.vogel.de/vogelonline/companyimg/134600/134600/65.jpg)

:quality(80)/p7i.vogel.de/wcms/1f/6d/1f6d6400ea742fe9d413efd486d30781/0126881343v1.jpeg)

:quality(80)/p7i.vogel.de/wcms/16/8c/168c8beb63d567667cdad67cd61a5fa0/0125728398v1.jpeg)